With an increasingly powerful search for images in Google Photos to identify people or pets, the application from the company Mountain View (California) continues to lost for gorilla identification. A rather curious fact that becomes a battlefront for this application. The truth is that the problem is not unique to Google and other smart classification systems such as Apple, Amazon or Microsoft also fail in this regard.

The truth is that if Google Photos has stood out for anything, it’s simply for its ability to reorganize the vast amount of photos that can be stored on a mobile phone. Its image analysis, when it was launched in 2015, was a revolution in the possibility of tagging people, places and things and thus allowing the user to carry out all kinds of quick searches.

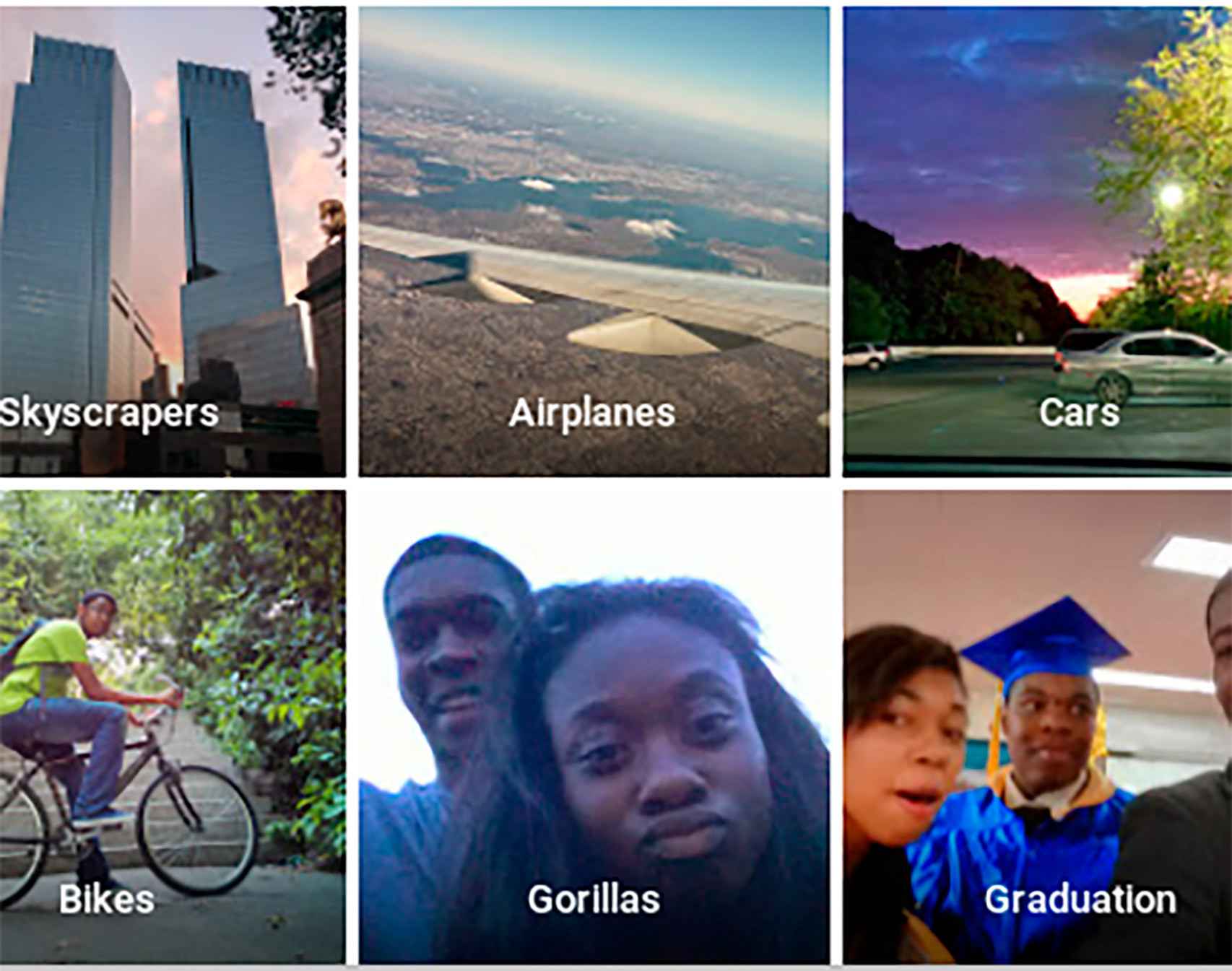

It was only a few months after its release that a software developer, Jacky Alciné, discovered that Google had tagged his photos and those of a friend, both dark-skinned, as “gorillas”; an inherently offensive term. Google’s response was prevent anything from being cataloged in your app as bouncers.

Jacky Alciné and his capture of Google Photos

WNYC-Studios

free android

With all the irruption of AI this year and its great power to amaze half the world, The New York Times put this app to the test to see if this confusing issue has been resolved. Actually, checked whether the same apps from Apple, Amazon and Microsoftwho use AI to identify objects or people, are also capable of this search.

After proving that the Mountain View boys’ app was very useful for searching through a collection of animals, including cats or kangaroos, back when the same test was done for gorillas, he failed miserably

Failure at Apple, Microsoft and Amazon

Worse, this experiment was also carried out on Apple Photos to end up in the same situation: finding certain animals, but the same thing happens with primates. The interesting thing is that in the Cupertino application only found an associated photo when the text was written which describes the gorilla.

Not to mention Microsoft OneDrive, unable to search for animals, while Amazon Photos has devoted itself to showing too many resultsalthough it is true that when researching primates he visualized a variety of them, but not at all concisely with a term like “gorilla”.

picture of lemurs

iStock

free android

There is an exception for Apple Photos and Google Photos, lemurs, a member of the primate family both of them were able to identify. This may be because this type of primate has more characteristic features than monkeys or orangutans, such as its large eyes and long tail.

The fears of Google and Apple

Sometimes in life you have to be practical, and here the two tech giants haven’t beaten around the bush, so their decision is to disable image identification for search results related to primates; especially for him fear of committing an offense to some of the millions of users who use their apps daily.

[Google I/O 2023: arranca una nueva era basada en la Inteligencia Artificial]

We continue with the curiosity to be in front of a technology that has practically gone around the world at the moment, and even so, the learning systems, on which ChatGPT itself is based, find themselves facing a supposed defeat when a user simply searches for “gorilla” in your applications.

Alciné himself was frustrated when he discovered that Google, after 8 years, had still not solved the problem and he dropped that he had no confidence in this AI. As collected The Wall Street Journal in his report: errors may reflect racist attitudes among those who program the data.

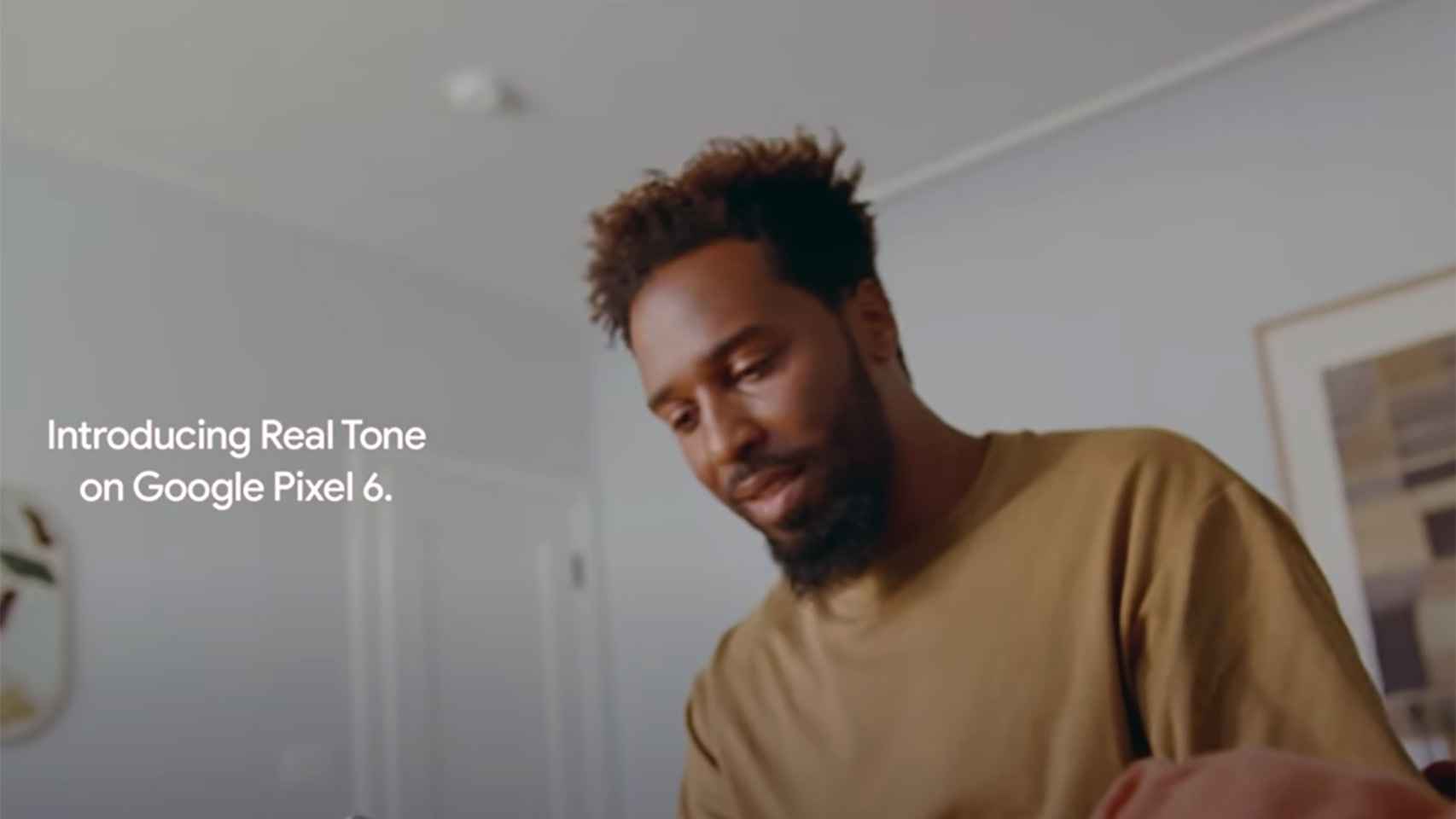

Real Tone de Google

El Androide libre

De hecho, tal como cita el medio neoyorquino, ante el incidente del gorila, dos empleados de Google que trabajaron en esta tecnología dijeron que el problema yacía en que la compañía no había puesto las suficientes fotos de personas de color en la colección de imágenes que se usaron para entrenar su sistema de inteligencia artificial.

Por lo que el sistema se encontraba ante dificultades en el momento de la identificación de personas con la piel más oscura y, por ello, lo confundía con este primate.

La ambigüedad de la IA de hoy

Todos los miedos que se han generado desde que ChatGPT irrumpiera en escena se deben a casi esto mismo, que la inteligencia artificial forme cada vez más parte de los quehaceres diarios de millones de personas, y ésta malinterprete algunos aspectos o cualquier experiencia vital de forma indebida, al no haber sido entrenada debidamente bajo unos principios éticos y morales.

La discusión es permanente desde hace unos meses, y los comportamientos impropios de ChatGPT han sido casi una constancia, para que la misma Google se vanaglorie de Bard al indicar que su entrenamiento está basado en principios éticos para corresponder al interés de millones de personas de todo el planeta, dé igual su color, raza o género.

Imagen de Sundar Pichai, CEO de Google

La misma IA de OpenAI ha respondido a veces de forma muy abrupta a los usuarios para que se limitase el uso con el chatbot. Aquí aparece en escena Vicente Ordóñez, profesor en la Universidad de Rice de Houston (Texas), que mantiene que resolver estos problemas es de gran importancia, ya que cómo se podrá confiar en este software ante otro tipo de escenarios.

Volviendo a Google Fotos y las apps del resto de compañías, Michael Marconi, portavoz de Google, dijo que han evitado que la app identificase a alguien como un mono o chimpancé porque el beneficio no compensa el riesgo de daño. Apple declinó hacer ningún tipo de comentarios sobre su app, mientras que Microsoft y Amazon mantienen que siempre están buscando la forma de mejorar sus productos.

Real Tone en el Google Pixel 6

El Androide Libre

Y es que tampoco se está ante una excepción, sino que otros productos tecnológicos están siendo criticados por su incapacidad para detectar personas con la piel oscura; o el mismo Apple Watch, que según una demanda, falló en medir de forma precisa los niveles de oxígeno en sangre a través de distintos colores de piel. Tampoco hay que olvidarse en cómo HP tuvo que retractarse públicamente para afirmar que sus webcams no eran racistas.

Hay muchos más ejemplos de cómo hay una especie de “vagueza” para entrenar los sistemas para que ofrezcan la misma experiencia a todas las personas, dé igual el color de su piel. La misma cámara Nest de Google, que usa la IA para determinar si alguien en el hogar es un familiar o no, etiquetó a varias personas de color como animales. Por suerte, Google corrigió el problema antes de que se lanzase el producto al mercado, tal como recoge un empleado que trabajó para la tecnológica en ese momento.

Sí que es verdad que Google está más motivado últimamente con la inclusión de Real Tone, una serie de filtros disponible en su app de fotos que muestra el color real para personas con la piel más oscura; otro tema relacionado con la fotografía que habría que tocar aparte al estar muy vinculado a todo lo mencionado. Lo que queda es la sensación de una “vagueza” por parte de los gigantes tecnológicos en el entrenamiento de la IA y todos esos sistemas de identificación de imágenes usados en una gran variedad de productos que finalmente llegan al mercado.

Te puede interesar

Sigue los temas que te interesan

Table of Contents