Just four days ago we learned that GPT-4 was a reality and just recently OpenAI has just presented it with all its virtues and advantages. A pre-trained generative system that brings the current GPT-3.5 generation to the GPT-4 version.

[ChatGPT para coches es oficial: este será el primer fabricante que usará la IA]

GPT-4 is here

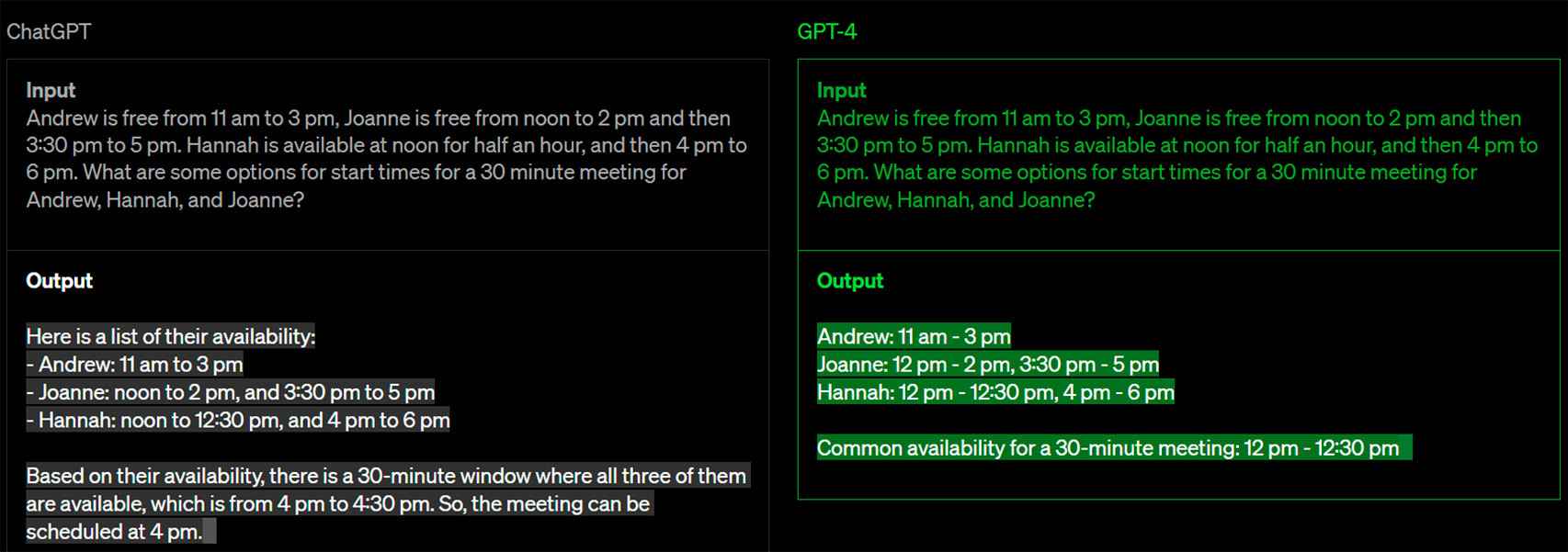

The current ChatGPT which surprised everyone in technology is based on GPT-3.5, so this new version, GPT-4, will be able to perform other types of tasks and functions.

At first it will be able to generate text in images and there is a point to take into account, collecting the own words of the team behind OpenAI, it will demonstrate an almost human level of performance already proven in different academic and professional environments.

Comparison of the two versions

The free Android

In other words, via Engadget, if ChatGPT surprised you with its level of ability to hold natural conversations, what we will see with its next version will be even higher.

In fact, the OpenAI team itself states that it has spent the past six months refining and optimizing system performance based on general feedback from the tens of thousands of users who use ChatGPT.

Passing certain academic and professional tests h elped him score in the top 10% of those examined before tests such as Uniform Bar, LSAT, or GRE. To better situate this score, GPT-3.5 scored in the bottom 10%.

It has also scored against other major language models such as LLMs in a wide variety of tests conducted. OpenAI emphasizes that this new version is characterized by its factuality and its addressability.

You can use it with ChatGPT Plus

Como no, GPT-4 estará disponible tanto para ChatGPT y el API, aunque se necesitará suscribirse a ChatGPT Plus para disfrutar de sus novedades. El acceso para el nuevo modelo será gestionado a través de una lista de espera, así que si estás muy interesado en ser uno de los primeros en probarlo, pásate por este enlace.

OpenAI mantiene que ChatGPT bajo esta nueva versión será más confiable, creativo y capaz de manejar instrucciones mucho más matizadas. Entre sus capacidades se encuentra esa función multimodal que generará textos, ya sea lenguaje natural, código para programar o una mezcla de entradas de texto e imágenes.

Es decir, será muy versátil para que pueda escanear libros de texto o manuales de instrucciones o mismamente coger una gráfica de resultados de beneficios anuales y examinarla. Por lo que se va a convertir en una herramienta de mayor utilidad para que entre otras de sus capacidades esté la habilidad de escanear capturas de pantalla y así dar resúmenes cortos, pero bien completos.

OpenAI ha dado ejemplos de cómo GPT-4 “alucinará” de una forma menor que su predecesor y el nuevo modelo tiene un 82 % menos de probabilidades de responder a solicitudes para contenido no permitido comparado a GPT-3.5.

GPT-4 ya parece en estas apps y plataformas

El Androide Libre

De hecho, ahora GPT-4 cuenta con 50 expertos en una gran variedad de campos profesionales para probar el modelo y ayudarlo a reducir su hábito para mentir. Aquí hay que puntualizar que se ha reducido este hábito en un 40 % menos, así que no está resuelto del todo y el mismo GPT avisará de que hay que tomar con pinzas algunas de sus respuestas, sobre todo en contextos de alto riesgo.

Te puede interesar

Sigue los temas que te interesan